Technical SEO là nhóm công việc giúp công cụ tìm kiếm crawl, render và index nội dung của bạn đúng cách, nhanh và ổn định. Cấu hình kỹ thuật tốt là nền móng để on-page và nội dung phát huy hiệu quả.

Bài viết này tập trung vào tiêu chí, bước triển khai và checklist ưu tiên. Không lan man định nghĩa, đi thẳng vào thứ cần đo, cần sửa và cách kiểm soát rủi ro. Với đội SEO và dev cần phối hợp nhanh quanh crawl, index và hiệu năng, một workflow SERP-first như Solytix giúp mọi người nhìn cùng một bức tranh ưu tiên.

Lược đồ dòng crawl → render → index và các điểm kiểm soát kỹ thuật chính

Technical SEO là gì và vì sao quan trọng

Technical SEO đảm bảo website có thể được thu thập dữ liệu, phân tích và xếp hạng hiệu quả. Nếu bot không truy cập được, tải chậm hoặc tín hiệu mâu thuẫn (canonical sai, redirect lặp), nội dung tốt cũng khó hiện diện.

Technical SEO là làm gì trong tổng thể SEO

Công việc cốt lõi:

- Mở đường crawl và index: robots.txt, sitemap, noindex/canonical, quản trị tham số URL.

- Tối ưu hiệu năng: Core Web Vitals, máy chủ, CDN, caching, tối ưu JS/CSS/ảnh.

- Cấu trúc thông tin: kiến trúc silo, internal link, breadcrumbs, URL chuẩn.

- Trải nghiệm và tính sẵn sàng: mobile-first, ổn định bố cục, bảo mật, uptime.

- Quản trị biến thể: redirect, chuẩn hóa www/http-https, lỗi 404, quốc tế hóa (hreflang).

- Dữ liệu có cấu trúc: schema phù hợp để đủ điều kiện hiển thị rich results.

Mối liên hệ với On-page và Off-page

- Technical SEO tạo nền tảng: khi bot crawl nhanh, tín hiệu rõ ràng, link equity được phân bổ đúng, on-page mới “được đọc” đầy đủ.

- Off-page (backlink, PR) phát huy tốt hơn khi không bị thất thoát qua chuỗi redirect, trang 404, canonical sai hoặc tốc độ kém.

- Triển khai theo thứ tự: Kỹ thuật ổn định → On-page/nội dung → Mở rộng Off-page.

Các chỉ số và mục tiêu cần theo dõi

- Indexing & crawl:

- Tỷ lệ trang hợp lệ trong Index vs tổng URL hợp lệ trong sitemap.

- Crawl stats: crawl requests, response time, status code phân bổ.

- Lỗi phủ sóng: soft 404, redirect error, blocked by robots, alternate page with proper canonical.

- Hiệu năng:

- Core Web Vitals: LCP, INP, CLS đạt ngưỡng “Tốt” cho phần lớn người dùng.

- TTFB, tải tài nguyên tĩnh, kích thước JS/CSS, kích thước ảnh trung bình.

- Tính toàn vẹn:

- Tỷ lệ 5xx, 4xx, uptime, chứng chỉ HTTPS hợp lệ, lỗi mixed content.

- Cấu trúc:

- Số trang mồ côi, độ sâu click, vòng lặp/chuỗi redirect, tính nhất quán URL.

Kiểm tra khả năng crawl và index

Mục tiêu: cho bot đường đi rõ ràng, không chặn nhầm, không để trang chất lượng thấp tiêu tốn ngân sách crawl.

robots.txt, noindex và canonical

- robots.txt:

- Chỉ dùng để kiểm soát crawl, không đảm bảo chặn index. Tránh chặn nhầm thư mục chứa CSS/JS cần thiết cho render.

- Nên khai báo đường dẫn sitemap trong robots.txt.

- Meta robots và x-robots-tag:

- noindex để ngăn index; nofollow ít dùng ở cấp trang trừ trường hợp đặc biệt.

- X-robots-tag áp dụng cấp tài nguyên (PDF, ảnh).

- Canonical:

- Dùng rel="canonical" khi có nhiều URL trùng/lân cận nội dung. Canonical phải là 200, indexable, tự tham chiếu ở bản chuẩn.

- Tránh mâu thuẫn: canonical A→B nhưng internal link trỏ A, sitemap liệt kê A.

Sitemap XML và phân tách sitemap lớn

- Chỉ liệt kê URL 200, indexable, không noindex/redirect/canonical sang trang khác.

- Phân tách theo loại và tần suất thay đổi: bài viết, sản phẩm, danh mục; mỗi file ≤ 50.000 URL hoặc 50MB.

- Với website lớn, tạo sitemap index (chứa nhiều sitemap con). Có thể có image/news sitemap nếu phù hợp.

Xử lý trang trùng lặp và tham số URL

- Nguồn trùng lặp: pagination, sắp xếp/lọc (facets), session ID, UTM.

- Giải pháp:

- Canonical về bản “chuẩn” (không tham số) với trang lọc không nhằm mục tiêu SEO.

- noindex với trang tìm kiếm nội bộ, trang lọc vô hạn biến thể.

- Chuẩn hóa tham số quan trọng (ví dụ ?color=) nếu có nhu cầu index có chọn lọc và tạo trang đích độc nhất, nội dung khác biệt.

- Tránh tạo URL khác nhau chỉ vì slash/viết hoa/dấu “/” cuối.

Dùng Search Console để phát hiện lỗi thu thập dữ liệu

- Page Indexing report: xem lý do không index, ưu tiên sửa “Blocked by robots.txt”, “Soft 404”, “Alternate page with canonical”.

- Crawl Stats: phát hiện tăng đột biến 5xx, thời gian phản hồi máy chủ.

- Inspect URL: kiểm tra indexability, canonical được chọn, ảnh hưởng robots/meta.

Tối ưu hiệu năng và Core Web Vitals

Core Web Vitals là tín hiệu trải nghiệm trang. Tập trung vào dữ liệu người dùng thực (field data) và xử lý nguyên nhân gốc: render-blocking, media nặng, máy chủ chậm.

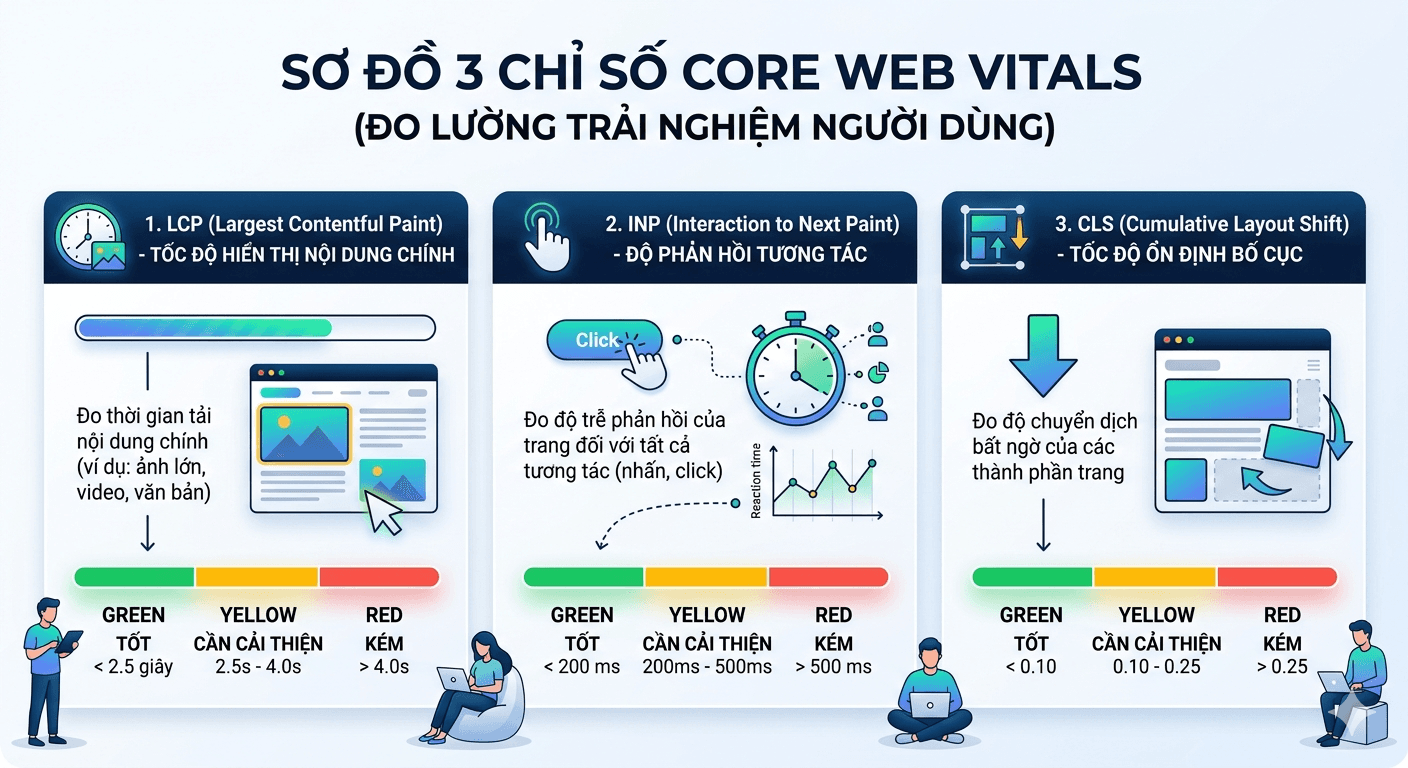

Biểu đồ ngưỡng LCP/INP/CLS và các yếu tố tác động thường gặp

Đo lường LCP, INP, CLS và ngưỡng đạt

- LCP (Largest Contentful Paint): < 2.5s với 75% người dùng.

- INP (Interaction to Next Paint): < 200ms với 75% người dùng.

- CLS (Cumulative Layout Shift): < 0.1 với 75% người dùng.

- Dùng: báo cáo Core Web Vitals trong Search Console, CrUX, Lighthouse (lab) để tìm nguyên nhân.

Nén ảnh, lazy-load, định dạng hiện đại

- Chuẩn định dạng: AVIF/WEBP ưu tiên, fallback JPEG/PNG khi cần.

- Responsive images: srcset + sizes để tải kích thước phù hợp viewport.

- Lazy-load ảnh/iframe ngoài màn hình; preload hero image (LCP) đúng kích thước.

- Tối ưu SVG (inline với icon nhỏ), loại bỏ EXIF không cần.

Giảm JavaScript chặn hiển thị và tối ưu CSS

- JS:

- defer/async script không quan trọng cho render; trì hoãn bên thứ ba nếu có thể.

- Code-splitting, tree-shaking; tránh hydrate nặng cho thành phần tĩnh.

- Ưu tiên tương tác quan trọng, debounce/throttle xử lý sự kiện.

- CSS:

- Critical CSS inline cho phần trên màn hình; tải phần còn lại async.

- Loại bỏ CSS không dùng, giảm @import lồng nhau; dùng HTTP/2 để song song hóa.

Tối ưu máy chủ, CDN và caching

- Máy chủ/CDN:

- Rút ngắn TTFB; bật HTTP/2/3, TLS hiện đại, nén Brotli.

- Đặt CDN gần người dùng, cache HTML tĩnh khi phù hợp, stale-while-revalidate.

- Caching headers:

- static assets: cache-control max-age dài + immutable; gắn version qua filename.

- HTML: tùy chiến lược (SSR/ISR), đảm bảo không phục vụ nội dung lỗi thời nhạy cảm.

Cấu trúc website và điều hướng

Cấu trúc rõ ràng giúp bot hiểu chủ đề, luồng liên kết nội bộ và ưu tiên crawl tài nguyên quan trọng.

Sơ đồ kiến trúc silo từ trang chủ → danh mục → bài viết/sản phẩm

Kiến trúc silo và chiều sâu crawl hợp lý

- Gom nhóm nội dung theo chủ đề (silo). Mỗi silo có trang trụ (hub) liên kết đến bài con.

- Quy tắc: đa số nội dung quan trọng ≤ 3 cú nhấp từ trang chủ/hub.

- Tránh “mồ côi” bằng liên kết ngược về hub, danh mục liên quan.

Internal link và phân bổ PageRank

- Liên kết ngữ cảnh ở đoạn phù hợp, anchor text mô tả tự nhiên.

- Tăng liên kết đến trang có giá trị kinh doanh/SEO cao.

- Kiểm tra và xử lý:

- Trang mồ côi, liên kết hỏng (4xx), chuỗi redirect nội bộ.

- Nofollow nội bộ hầu như không cần, tránh rò rỉ tín hiệu.

Breadcrumbs và menu thân thiện bot

- Breadcrumbs giúp hiểu phân cấp nội dung; dùng đánh dấu BreadcrumbList.

- Menu:

- HTML có thể crawl, không phụ thuộc hoàn toàn JS.

- Tránh mega menu quá sâu gây lặp liên kết không cần thiết.

Quy ước URL rõ ràng, nhất quán

- Dùng chữ thường, gạch ngang, từ khóa mô tả ngắn gọn; tránh ký tự đặc biệt.

- Duy trì nhất quán slash cuối; redirect 301 về phiên bản chuẩn.

- Không mã hóa tham số vô nghĩa vào đường dẫn; tránh thay đổi URL không cần thiết.

Dữ liệu có cấu trúc và kết quả hiển thị phong phú

Schema đúng giúp máy hiểu thực thể và có thể đủ điều kiện hiển thị dạng kết quả phong phú.

Chọn schema phù hợp từng loại trang

- Toàn site: Organization/Website, BreadcrumbList, Sitelinks Search Box (khi phù hợp).

- Bài viết/tin: Article/BlogPosting.

- Sản phẩm: Product + Offer + AggregateRating (khi có).

- Hỏi đáp/Hướng dẫn: FAQPage, HowTo (phù hợp nội dung và chính sách).

- Local: LocalBusiness với NAP nhất quán.

- Lưu ý: chỉ đánh dấu nội dung thực sự hiển thị và đáp ứng yêu cầu đủ điều kiện.

Kiểm tra bằng công cụ Rich Results Test

- Dán URL/đoạn mã để xác thực lỗi, cảnh báo, khả năng đủ điều kiện kết quả phong phú.

- Kết hợp báo cáo trong Search Console để theo dõi trạng thái ở quy mô lớn.

Xử lý lỗi đánh dấu và duy trì tính nhất quán

- Tránh mâu thuẫn giữa dữ liệu có cấu trúc và nội dung hiển thị (giá, tình trạng kho).

- Ưu tiên JSON-LD; hợp nhất nhiều khối cùng loại nếu cần.

- Thiết lập quy trình cập nhật dữ liệu có cấu trúc khi thay đổi mẫu giao diện.

Tính khả dụng trên di động và trải nghiệm người dùng

Mobile-first indexing đặt bản di động làm tiêu chuẩn. Ưu tiên hiển thị đầy đủ nội dung, tốc độ và khả năng tương tác.

Responsive và tương thích thiết bị

- Viewport meta đúng; lưới responsive; ảnh và video co giãn.

- Kích thước vùng nhấn đủ lớn, khoảng cách hợp lý; font-size tối thiểu dễ đọc.

Tối ưu tương tác đầu tiên và bố cục ổn định

- Giảm công việc luồng chính (main thread), trì hoãn script không cần khi tải đầu.

- Đặt kích thước cố định cho media/ads; dùng CSS để giữ chỗ, tránh CLS.

- Ưu tiên trạng thái tải có skeleton hợp lý thay vì layout nhảy.

Kiểm tra với Lighthouse và báo cáo trải nghiệm trang

- Dùng Lighthouse (lab) để xác định tác nhân chậm; xác thực lại bằng field data (CrUX, Search Console).

- Theo dõi Page Experience trong Search Console để biết tỷ lệ URL “tốt” trên từng thiết bị.

Bảo mật và tính toàn vẹn website

Bảo mật tốt bảo vệ người dùng và tín hiệu SEO: trình duyệt/bot tránh trang không an toàn, giảm cảnh báo.

HTTPS, HSTS và chứng chỉ hợp lệ

- Bắt buộc HTTPS; redirect 301 từ HTTP → HTTPS; cập nhật canonical, sitemap, hreflang.

- Bật HSTS (Strict-Transport-Security) và cân nhắc preload khi sẵn sàng.

- Gia hạn chứng chỉ kịp thời; tránh lỗi chuỗi chứng chỉ.

Chặn nội dung trộn lẫn và lỗ hổng phổ biến

- Mixed content: đảm bảo mọi tài nguyên (ảnh, script, iframe) tải qua HTTPS.

- Giảm rủi ro XSS/CSRF bằng thực hành mã hóa an toàn và xác thực đầu vào.

Header bảo mật và bảo vệ bot xấu

- Cấu hình: Content-Security-Policy, X-Frame-Options, X-Content-Type-Options, Referrer-Policy.

- Bảo vệ khỏi bot xấu: rate limiting, WAF; lưu ý robots.txt không phải công cụ bảo mật.

Quản lý phiên bản, chuyển hướng và lỗi

Chuẩn hóa bản chuẩn duy nhất, chuyển hướng đúng mục đích và xử lý lỗi hữu ích cho người dùng.

301, 302, 307 và tránh chuỗi redirect

- 301: vĩnh viễn, chuyển tín hiệu mạnh nhất.

- 302/307: tạm thời; 307 giữ phương thức request.

- Tránh chuỗi/ vòng lặp redirect; hướng thẳng đến đích cuối; cập nhật internal link về URL chuẩn.

Trang 404 hữu ích và theo dõi lỗi

- Giữ mã trạng thái 404/410 đúng; giao diện gợi ý trang liên quan, ô tìm kiếm, liên kết về chuyên mục.

- Theo dõi 404 từ log và Search Console; sửa link nội bộ hỏng, cân nhắc redirect khi có trang thay thế phù hợp.

Chuẩn hóa www, http/https và đa miền

- Chọn một hostname chuẩn (www hoặc non-www) và duy trì nhất quán trên canonical, sitemap, hreflang.

- Tránh phục vụ nội dung giống hệt trên nhiều miền; nếu cần, dùng redirect hoặc canonical xuyên miền khi phù hợp.

Quốc tế hóa và nội dung đa ngôn ngữ

Triển khai hreflang chính xác và kiến trúc phù hợp để phục vụ đúng người dùng theo ngôn ngữ/vùng.

Ma trận hreflang vi-VN, en-US, en-GB với x-default và quy tắc đối xứng

Hreflang đúng vùng và ngôn ngữ

- Cú pháp: rel="alternate" hreflang="vi-VN" href="..." và liên kết đối xứng giữa các biến thể.

- Dùng x-default cho trang chọn ngôn ngữ/chuyển hướng tự động.

- Mỗi trang cần tự tham chiếu hreflang và liệt kê mọi biến thể tương ứng.

Xử lý bản dịch, trang trùng lặp và geo-targeting

- Kiến trúc: ưu tiên thư mục con (example.com/vi/) khi có một miền; ccTLD cho chiến lược địa phương hóa mạnh.

- Tránh nội dung dịch máy công khai không kiểm duyệt chất lượng.

- Canonical trong cùng ngôn ngữ; hreflang để liên kết giữa các ngôn ngữ/vùng tương ứng.

Checklist Technical SEO theo mức độ ưu tiên

Áp dụng lộ trình theo tác động và độ rủi ro. Đo trước–sau để xác nhận hiệu quả.

Mục cần làm ngay trong 24-72 giờ

- Kiểm tra robots.txt có chặn nhầm không; mở crawl cho CSS/JS cần thiết.

- Xác nhận sitemap chỉ chứa URL 200, indexable; gửi lại trong Search Console.

- Sửa redirect vòng lặp/chuỗi dài cho các trang top traffic.

- Bật HTTPS đúng, redirect HTTP→HTTPS; sửa canonical mâu thuẫn lớn.

- Khắc phục lỗi 5xx, 4xx cao đột biến; đảm bảo uptime.

- Kiểm tra Core Web Vitals báo đỏ cho mẫu trang trọng yếu (trang chủ, sản phẩm, bài viết).

Tối ưu trong 2-4 tuần

- Tối ưu LCP/INP/CLS: ảnh hero, critical CSS, defer JS, preload tài nguyên quan trọng.

- Tái cấu trúc internal link: xử lý trang mồ côi, tăng liên kết đến trang tiền tệ.

- Thiết lập schema chuẩn cho Article/Product/Breadcrumb/Organization.

- Chuẩn hóa URL, quy ước slash, giảm tham số không cần; chiến lược faceted navigation.

- Cấu hình CDN, caching headers, nén Brotli; tối ưu máy chủ/HTTP/2.

- Thiết lập quy trình log analysis và giám sát lỗi crawl.

Bảo trì định kỳ hàng tháng và hàng quý

- Rà soát Search Console: Indexing, CWV, Enhancements, Security.

- Thu thập log: kiểm tra tỷ lệ bot truy cập, 4xx/5xx, tài nguyên nặng lặp lại.

- Kiểm tra link hỏng, redirect phát sinh; cập nhật canonical/sitemap khi nội dung thay đổi.

- Xem lại schema theo yêu cầu mới; kiểm thử Lighthouse định kỳ.

- Kiểm tra chứng chỉ, header bảo mật, mixed content sau cập nhật nền tảng.

Công cụ đề xuất để triển khai và đo lường

Kết hợp số liệu lab và field, báo cáo định kỳ và cảnh báo thời gian thực để không bỏ lỡ lỗi nghiêm trọng.

Google Search Console, Analytics và Lighthouse

- Search Console: phủ sóng index, CWV (field), enhancements, sitemaps, crawl stats, URL Inspection.

- Google Analytics/GA4: hiệu suất trang, thiết bị, khu vực; đối chiếu tác động tối ưu kỹ thuật đến hành vi.

- Lighthouse: phân tích lab về hiệu năng, accessibility, best practices, SEO cơ bản.

Trình thu thập, phân tích log và giám sát uptime

- Trình thu thập (crawler): rà soát indexability, internal link, status code, meta/headers.

- Phân tích log máy chủ: thấy bot nào truy cập, tần suất, lỗi 4xx/5xx, tài nguyên tốn thời gian.

- Giám sát uptime/hiệu năng: cảnh báo khi TTFB tăng, tỷ lệ lỗi vượt ngưỡng.

Quy trình báo cáo và theo dõi cải tiến

- Dashboard hợp nhất: GSC, GA4, log, kiểm thử CWV; so sánh tuần/tháng.

- Chu kỳ: báo cáo ngắn hằng tuần (lỗi, hotfix), tổng hợp tháng (xu hướng, thắng–thua), rà soát quý (kiến trúc, chiến lược).

- Khi số URL và số đội tham gia tăng, “báo cáo tay” dễ trễ nhịp; khi đó nên nghĩ theo SEO automation để cố định luồng tín hiệu → cảnh báo → việc cần làm, và dùng workflow SEO tự động nếu bạn cần xếp các bước kiểm thử–triển khai–đo lại thành một guồng lặp lại.

- Có thể gom dữ liệu vào một bảng điều khiển tập trung như Solytix để tiện theo dõi tiến độ và cảnh báo; nếu bạn cần đi xa hơn một dashboard, liên hệ để tham khảo cách tổ chức workflow SEO automation giữa SEO, nội dung và kỹ thuật.

Các lỗi kỹ thuật thường gặp và cách khắc phục nhanh

Ưu tiên khắc phục lỗi ngăn index, gây tụt hiệu năng diện rộng hoặc làm đứt mạch điều hướng.

Trang bị chặn crawl ngoài ý muốn

- Nguyên nhân: Disallow rộng trong robots.txt, noindex rơi vãi, 401/403 do WAF/CDN, canonical trỏ sai.

- Khắc phục:

- Soát robots.txt theo thư mục; mở crawl cho CSS/JS.

- Tìm và gỡ noindex không chủ đích; sửa header x-robots-tag.

- Kiểm tra firewall/CDN rules; cấp quyền cho Googlebot; đảm bảo 200 cho trang quan trọng.

- Sửa canonical tự tham chiếu về URL chuẩn.

Nội dung trùng lặp và canonical sai

- Triệu chứng: “Duplicate, Google chose different canonical” trong Search Console, trang mỏng bị cạnh tranh nội bộ.

- Khắc phục:

- Thiết lập canonical nhất quán; cập nhật internal link về URL chuẩn.

- Hợp nhất trang mỏng nội dung tương đồng; 301 khi cần thiết.

- Giảm tham số sinh biến thể; noindex trang lọc không có mục tiêu search.

Core Web Vitals kém do JS và media nặng

- Triệu chứng: LCP chậm ở trang nhiều ảnh, INP cao ở trang nhiều tương tác, CLS do banner/ads.

- Khắc phục nhanh:

- Chuyển ảnh hero sang AVIF/WEBP, preload đúng kích thước; lazy-load phần còn lại.

- defer/async script phụ; split bundle; nén Brotli; critical CSS.

- Cố định kích thước vùng quảng cáo/media; dùng placeholder để tránh nhảy bố cục.

Câu hỏi thường gặp

Technical SEO khác on-page SEO ở điểm nào?

Technical SEO tập trung vào hạ tầng kỹ thuật giúp bot crawl, render và index website đúng cách, bao gồm tốc độ tải, cấu trúc URL, sitemap và bảo mật. On-page SEO là tối ưu nội dung và tín hiệu trên từng trang như tiêu đề, heading, từ khóa và internal link.

Core Web Vitals gồm những chỉ số nào và ngưỡng tốt là bao nhiêu?

Core Web Vitals gồm LCP dưới 2.5 giây, INP dưới 200ms và CLS dưới 0.1, tất cả đo trên 75% người dùng thực. Đây là tín hiệu trải nghiệm trang mà Google sử dụng trong thuật toán xếp hạng.

Nên ưu tiên sửa lỗi kỹ thuật nào trước tiên khi bắt đầu technical SEO?

Trong 24–72 giờ đầu hãy ưu tiên kiểm tra robots.txt không chặn nhầm CSS và JS, đảm bảo sitemap chỉ chứa URL hợp lệ, sửa chuỗi redirect vòng lặp và bật HTTPS đúng cách. Đây là những lỗi ảnh hưởng trực tiếp và diện rộng nhất đến khả năng index của Google.

Technical SEO là gì (định nghĩa ngắn)?

Technical SEO là tối ưu hạ tầng và cấu hình website để bot crawl, render và index đúng trang chuẩn, tải nhanh, an toàn và nhất quán về URL/canonical—làm nền cho on-page và off-page phát huy hiệu quả.

Ảnh chụp màn hình Lighthouse chỉ ra tài nguyên chặn hiển thị và đề xuất khắc phục