Google Index là cơ sở dữ liệu nơi Google lưu trữ các bản ghi đã xử lý của trang web để có thể hiển thị chúng trên kết quả tìm kiếm. Nếu một URL không nằm trong chỉ mục, người dùng sẽ không thể tìm thấy nó qua Google, dù nội dung có giá trị đến đâu.

Bài viết này giải thích rõ “google index là gì”, cơ chế lập chỉ mục hoạt động ra sao, cách kiểm tra và khắc phục lỗi không index, kèm hướng dẫn tăng tốc lập chỉ mục dựa trên các tín hiệu quan trọng mà Google quan tâm.

Sơ đồ quy trình từ crawl → render → canonical → index → serve kết quả tìm kiếm

Khái niệm và vai trò của Google Index

Hiểu đúng bản chất Google Index giúp bạn tối ưu nỗ lực SEO vào những việc có tác động thực tế: đảm bảo trang đủ điều kiện được lập chỉ mục trước khi nghĩ đến xếp hạng.

Google Index là gì và vì sao quan trọng với SEO

- Google Index là tập hợp các trang đã được Google thu thập, phân tích, kết luận canonical và lưu trữ để sẵn sàng phân phát khi có truy vấn phù hợp.

- Quan trọng vì: chỉ khi một URL được index, nó mới đủ điều kiện xếp hạng (ranking). Không index đồng nghĩa không có hiển thị organic.

- Chỉ mục không phải là ảnh chụp “nguyên bản” của HTML, mà là phiên bản đã được chuyển đổi sau render, trích rút thực thể, văn bản, liên kết và tín hiệu.

Phân biệt crawling, indexing và ranking

- Crawling (thu thập dữ liệu): Googlebot truy cập URL, tải tài nguyên (HTML, JS, CSS, ảnh), và có thể render để thấy nội dung cuối.

- Indexing (lập chỉ mục): hệ thống phân tích nội dung, loại trừ trùng lặp, xác định canonical, gắn ngữ nghĩa và quyết định có đưa vào chỉ mục hay không.

- Ranking (xếp hạng): khi người dùng tìm kiếm, Google chấm điểm mức độ phù hợp, chất lượng và nhiều tín hiệu khác để xếp thứ hạng các trang đã nằm trong chỉ mục.

Cách Google lập chỉ mục nội dung

Google bắt đầu từ việc khám phá URL (qua liên kết, sitemap, feed…), sau đó crawl, render, đánh giá chất lượng và quyết định có index. Tốc độ và tỷ lệ được lập chỉ mục phụ thuộc vào nhiều yếu tố nội dung và kỹ thuật.

Quy trình từ khám phá URL đến đưa vào chỉ mục

- Khám phá (Discovery): Google phát hiện URL mới qua liên kết nội bộ/ngoại, sitemap, RSS/Atom, và dữ liệu trước đó.

- Lập lịch crawl (Scheduling): Hệ thống quyết định mức độ ưu tiên, dựa trên tín hiệu website, crawl budget và lịch sử phản hồi máy chủ.

- Crawl & Render: Tải HTML, tài nguyên, và render (đặc biệt với nội dung phụ thuộc JavaScript).

- Phân tích & Trích rút: Rút nội dung chính, liên kết, thực thể, dữ liệu có cấu trúc, và ngôn ngữ.

- Loại trừ trùng lặp & Canonicalization: So sánh với trang tương tự; chọn URL canonical nếu có bản trùng lặp.

- Quyết định lập chỉ mục: Dựa vào chất lượng, tín hiệu kỹ thuật (noindex, robots), và chính sách của hệ thống.

- Phục vụ (Serving): Trang đã index sẵn sàng hiển thị khi có truy vấn phù hợp.

Minh họa pipeline: Discovery → Crawl → Render → Deduplicate → Canonical → Index

Tín hiệu ảnh hưởng khả năng được index

Ngoài việc không bị chặn bởi robots hoặc noindex, Google còn đánh giá nhiều tín hiệu để quyết định có đưa trang vào chỉ mục.

Chất lượng nội dung và tính độc nhất

- Nội dung phải hữu ích, giải quyết nhu cầu tìm kiếm rõ ràng, tránh lặp lại ý tưởng đã có trên website của chính bạn.

- Tránh nội dung mỏng (thin content), trang doorway, các trang tag/archive trùng lặp không đóng góp giá trị.

- Tập trung độ sâu chủ đề (topical depth), bao phủ thực tế, nguồn tham khảo rõ ràng khi cần thiết.

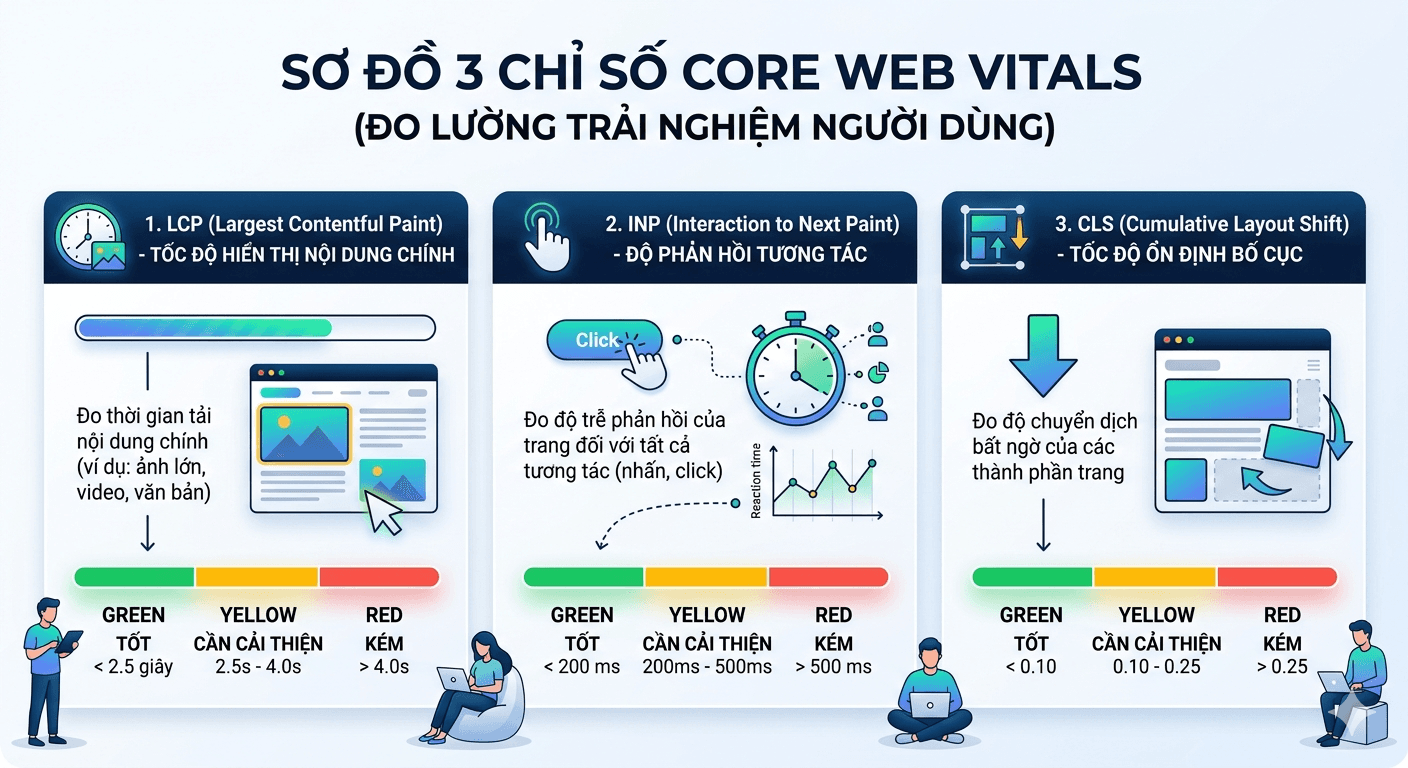

Tốc độ tải trang, Core Web Vitals

- Core Web Vitals (LCP, INP, CLS) và tốc độ phản hồi máy chủ ảnh hưởng đến khả năng thu thập và xử lý.

- Ưu tiên tối ưu:

- LCP: tối ưu ảnh hero, preload font/critical CSS, kích hoạt HTTP/2/3.

- INP: giảm JS nặng, tối ưu tương tác đầu tiên.

- CLS: cố định kích thước khung ảnh/quảng cáo, tránh nhảy layout.

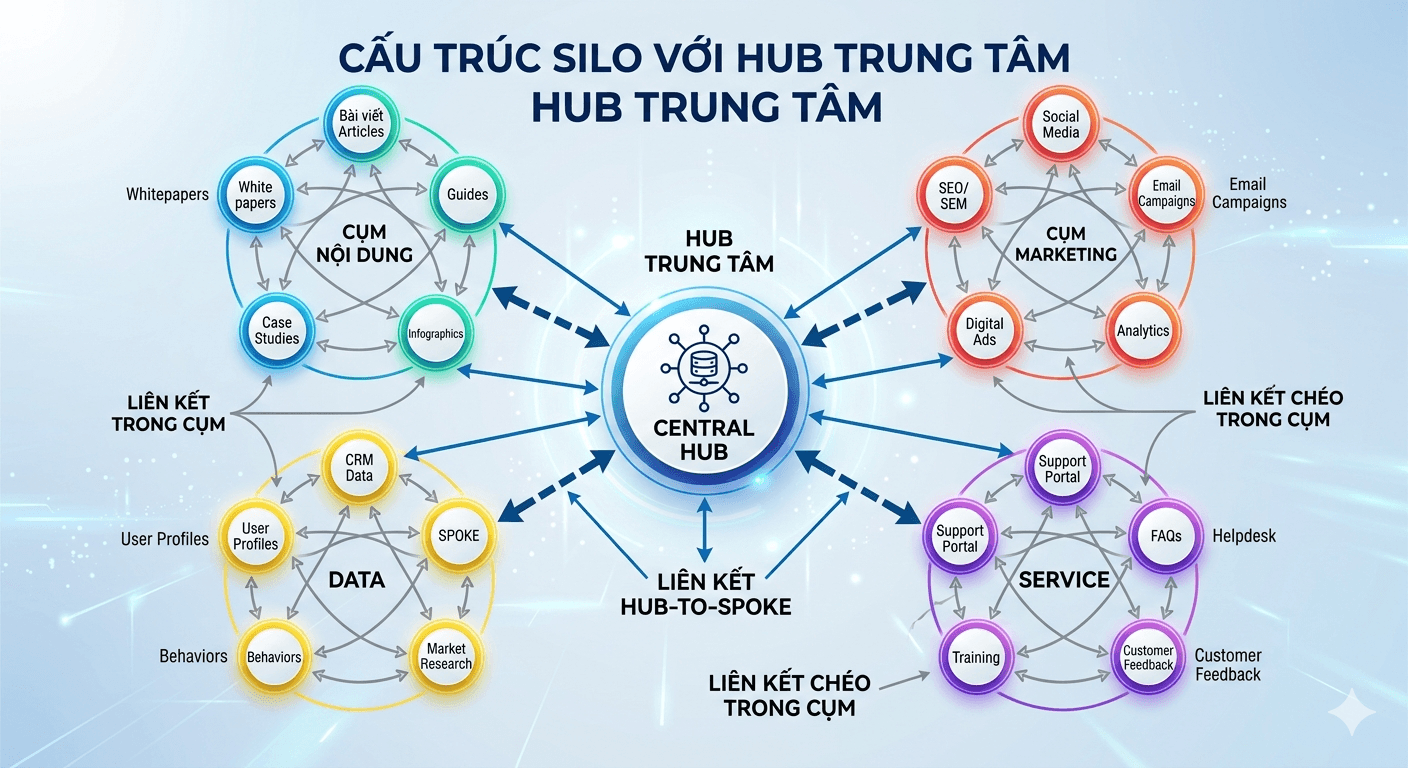

Internal link và cấu trúc website

- Trang không có liên kết nội bộ (orphan pages) thường khó được khám phá và index.

- Thiết kế cấu trúc phẳng hợp lý: danh mục → bài viết; breadcrumbs; liên kết ngữ cảnh tới các trang ưu tiên.

- Liên kết từ trang mạnh (homepage, hub) thường giúp URL mới được crawl sớm hơn.

Robots.txt, meta robots, canonical

- robots.txt: kiểm soát quyền crawl. Chặn crawl có thể khiến Google không thấy thẻ noindex trong trang.

- Meta robots / X-Robots-Tag: chỉ thị index/noindex, follow/nofollow ở mức trang hoặc HTTP header.

- Canonical: là gợi ý (không phải mệnh lệnh). Canonical sai có thể khiến trang bị coi là bản trùng lặp và không index.

Bảng tóm tắt nhanh:

- robots.txt: Chặn crawl; không đảm bảo chặn index nếu có tín hiệu mạnh từ nơi khác.

- meta robots noindex: Chặn index; cần cho phép crawl để Google thấy thẻ này.

- x-robots-tag (HTTP): Tương tự meta robots, áp dụng cả cho file không phải HTML.

- rel=canonical: Gợi ý URL chính; Google có thể bỏ qua nếu mâu thuẫn tín hiệu.

Cách kiểm tra tình trạng index của trang

Bạn có thể kiểm tra nhanh trên SERP hoặc dùng Google Search Console (GSC) để thấy lý do tại sao trang chưa được index và cách khắc phục.

Dùng site - query và kiểm tra nhanh trên SERP

- Dùng cú pháp: site:example.com “từ khóa” hoặc site:example.com/url-cụ-thể để ước đoán trang đã index chưa.

- Hạn chế: Kết quả site: không phải báo cáo đầy đủ. Một số URL có thể đã index nhưng chưa hiện ở site: do giới hạn hiển thị.

Sử dụng Google Search Console

GSC cung cấp dữ liệu chính xác về trạng thái index và nguyên nhân không index.

URL Inspection và Coverage report

- URL Inspection (Kiểm tra URL):

- Xem trạng thái: Indexed / Not indexed.

- Lý do phổ biến: Discovered – currently not indexed; Crawled – currently not indexed; Duplicate without user-selected canonical; Soft 404; Alternate page with proper canonical.

- Có thể “Yêu cầu lập chỉ mục” cho vài URL quan trọng sau khi khắc phục lỗi.

- Indexing/Pages (trước đây là Coverage report):

- Tổng quan số trang được index/không index.

- Lọc theo lý do cụ thể để xử lý theo nhóm.

Giao diện URL Inspection trong Google Search Console hiển thị trạng thái và lý do không index

Gửi sitemap và theo dõi lỗi

- Tạo sitemap.xml liệt kê URL canonical có thể index (200, không noindex, không bị chặn).

- Cập nhật lastmod chính xác; nén gzip nếu lớn; phân tách khi >50.000 URL.

- Gửi trong GSC (Sitemaps) và theo dõi cảnh báo: URL lỗi, noindex trong sitemap, 404, chuyển hướng.

Nguyên nhân phổ biến khiến trang không được index

Các vấn đề thường rơi vào ba nhóm: bị chặn ngoài ý muốn, nội dung/giá trị thấp, và sự cố kỹ thuật gây nhiễu tín hiệu.

Chặn crawl hoặc noindex ngoài ý muốn

- robots.txt chứa Disallow: / hoặc chặn thư mục chứa bài viết.

- Thẻ meta robots noindex, x-robots-tag noindex do cấu hình CMS/plugin.

- Trang đặt mật khẩu, tường lửa/WAF chặn Googlebot, lỗi 401/403.

- Canonical trỏ sang trang khác hoặc tên miền khác không hợp lý.

Nội dung mỏng, trùng lặp, hoặc chất lượng thấp

- Trang tag, filter, pagination tạo nhiều biến thể không khác biệt nội dung.

- Bài tự động tổng hợp (aggregated/scraped) thiếu giá trị gốc.

- Trang affiliate/skyscraper chỉ lặp lại mà không có phân tích hay dữ liệu bổ sung.

Sự cố kỹ thuật và tín hiệu hỗn tạp

Tín hiệu mâu thuẫn khiến Google nghi ngờ giá trị hoặc canonical của trang.

Chuỗi chuyển hướng, canonical sai

- Chuỗi 3xx dài, vòng lặp hoặc chuyển hướng tạm thời (302) kéo dài.

- rel=canonical trỏ tới URL 404/redirect hoặc mâu thuẫn với hreflang.

- Trùng lặp http/https, www/non-www, slash/non-slash không được 301 hợp nhất.

Sitemap lỗi thời hoặc chứa URL không hợp lệ

- Liệt kê URL 404, noindex, hoặc bị robots chặn.

- lastmod không chính xác; gửi quá nhiều biến thể tham số.

- Không đồng bộ canonical thực tế, dẫn tới Google bỏ qua sitemap.

Cách tăng tốc độ được index

Không có nút “bật là index ngay”, nhưng bạn có thể gia tăng xác suất và tốc độ bằng cách củng cố tín hiệu khám phá, nội dung, và tính nhất quán kỹ thuật.

Tối ưu nội dung và cấu trúc liên kết nội bộ

- Xuất bản nội dung đủ sâu, trả lời rõ nhu cầu tìm kiếm; dùng tiêu đề, mục lục, dữ liệu có cấu trúc phù hợp.

- Liên kết nội bộ:

- Thêm liên kết từ trang hub/danh mục và bài có traffic.

- Đặt liên kết ngữ cảnh tự nhiên, anchor rõ ràng về chủ đề.

- Tránh orphan pages; thêm vào sitemap/taxonomy phù hợp.

- Điều hướng: breadcrumbs, menu chính, trang chuyên mục sắp xếp tốt giúp crawl hiệu quả hơn.

Gửi yêu cầu index và cập nhật sitemap

- Với một số URL quan trọng: dùng URL Inspection → Request indexing sau khi khắc phục vấn đề.

- Cập nhật sitemap.xml và lastmod để báo hiệu thay đổi; gửi lại trong GSC khi có đợt cập nhật lớn.

- Đảm bảo HTTP header Last-Modified/ETag hợp lệ để Google nhận biết thay đổi nhanh hơn.

- Lưu ý: Indexing API hiện chỉ hỗ trợ một số loại nội dung cụ thể (ví dụ JobPosting, BroadcastEvent). Không nên lạm dụng dịch vụ/“API” không chính thức.

Tăng tín hiệu khám phá qua liên kết bên ngoài

- Nhận liên kết từ trang liên quan, được crawl thường xuyên.

- Chia sẻ nội dung trên kênh có bot truy cập (trang cộng đồng, thư mục ngành uy tín).

- Tránh spam liên kết; liên kết kém chất lượng không giúp index bền vững.

Tối ưu crawl budget cho website lớn

- Giảm trùng lặp: hội tụ biến thể URL (tham số lọc/sắp xếp) bằng canonical, 301, hoặc robots.txt cho phần không cần crawl.

- Ổn định máy chủ: thời gian phản hồi nhanh, hạn chế lỗi 5xx/timeout.

- Sitemap theo module/chuyên mục; loại bỏ URL yếu, 404/410 các trang bỏ đi.

- Nén HTML/CSS/JS, dùng HTTP/2/3, cache hợp lý để Googlebot thu thập hiệu quả.

Biện pháp duy trì chỉ mục bền vững

Sau khi được index, cần giữ chất lượng và tín hiệu ổn định để tránh bị loại khỏi chỉ mục theo thời gian.

Chu kỳ cập nhật nội dung và xử lý trang lỗi thời

- Xác định chu kỳ làm mới theo chủ đề: dữ liệu biến động nên có lịch cập nhật rõ ràng.

- Cập nhật thực chất (nội dung, ví dụ, dữ liệu), không “chạm tay” hời hợt.

- Trang lỗi thời/nhắm trùng ý định: gộp nội dung và 301 về trang chuẩn để tích lũy tín hiệu.

Chuẩn hóa URL và quản trị trùng lặp

- Chọn 1 phiên bản chuẩn: https + non-www hoặc www; 301 các biến thể còn lại.

- Quy ước dấu gạch chéo, chữ hoa/thường, đuôi .html/.php, tham số UTM… nhất quán.

- rel=canonical đặt ở trang đích cuối cùng, khớp nội dung; tránh canonical chéo miền khi không cần thiết.

- Hreflang: mỗi phiên bản ngôn ngữ trỏ canonical tới chính nó; cặp hreflang đối xứng.

Theo dõi báo cáo Indexing trong Search Console

- Theo dõi Indexing > Pages và Video indexing (nếu có).

- Crawl stats: phát hiện đột biến lỗi, latencies, hoặc thay đổi mẫu user-agent.

- Thiết lập cảnh báo email; ghi chú khi triển khai thay đổi để về sau phân tích nguyên nhân dễ dàng. Để theo dõi hiệu suất nội dung sâu hơn, có thể dùng thêm các công cụ phân tích như Solytix.

Giải đáp nhanh - h index google scholar là gì

Nhiều người nhầm “h-index” với Google Index. Đây là hai khái niệm hoàn toàn khác.

Khác biệt giữa Google Index và h-index học thuật

- Google Index: cơ sở dữ liệu các trang web đã được Google lập chỉ mục để hiển thị trên kết quả tìm kiếm.

- h-index (Google Scholar): thước đo ảnh hưởng khoa học của tác giả/nhà nghiên cứu. Một tác giả có h-index = h nếu có h bài báo, mỗi bài được trích dẫn ít nhất h lần. Ví dụ h-index = 12 nghĩa là có 12 bài, mỗi bài ≥ 12 lượt trích dẫn.

- Mối liên quan: không có. h-index là chỉ số học thuật; Google Index là hạ tầng tìm kiếm web.

Câu hỏi thường gặp

Mất bao lâu để một trang mới được index

Thường từ vài giờ đến vài ngày; với website mới hoặc crawl budget thấp có thể lâu hơn. Các yếu tố rút ngắn thời gian gồm: liên kết nội bộ từ trang mạnh, sitemap được cập nhật đúng, máy chủ phản hồi nhanh, và nội dung chất lượng rõ ràng.

Có nên dùng dịch vụ index nhanh

Không nên. Các dịch vụ “index nhanh” bên thứ ba thường dùng kỹ thuật rủi ro, có thể vi phạm nguyên tắc của Google và không đảm bảo kết quả bền vững. Hãy dùng kênh chính thống: tối ưu nội dung, cấu trúc liên kết, sitemap, và Request indexing trong GSC cho các URL quan trọng.

Xử lý khi trang bị deindexed

- Kiểm tra Search Console: Manual actions, Security issues, và URL Inspection.

- Rà soát robots.txt, meta/x-robots-tag noindex, trạng thái HTTP, chuyển hướng.

- Sửa lỗi nội dung/kỹ thuật; nếu là án phạt thủ công, gửi yêu cầu xem xét lại (reconsideration) sau khi khắc phục đầy đủ.

- Cập nhật sitemap và yêu cầu lập chỉ mục lại cho các URL ưu tiên. Theo dõi phản hồi trong GSC. Bạn cũng có thể theo dõi tác động thay đổi nội dung qua các nền tảng đo lường như Solytix.

Ví dụ thẻ meta robots và canonical đúng/sai trong HTML để tránh noindex ngoài ý muốn